介紹阿里巴巴集團推出的創新框架EMO,它利用聲音的力量將靜態肖像活躍起來。您只需提供一張參考圖像和一段音頻剪輯,例如講話或唱歌,EMO就能夠運用其魔力創造出有聲音頭像視頻。這些視頻不僅在面部動作表情上表達豐富,還能呈現多樣的頭部姿勢,能夠與您提供的音頻持續相符。

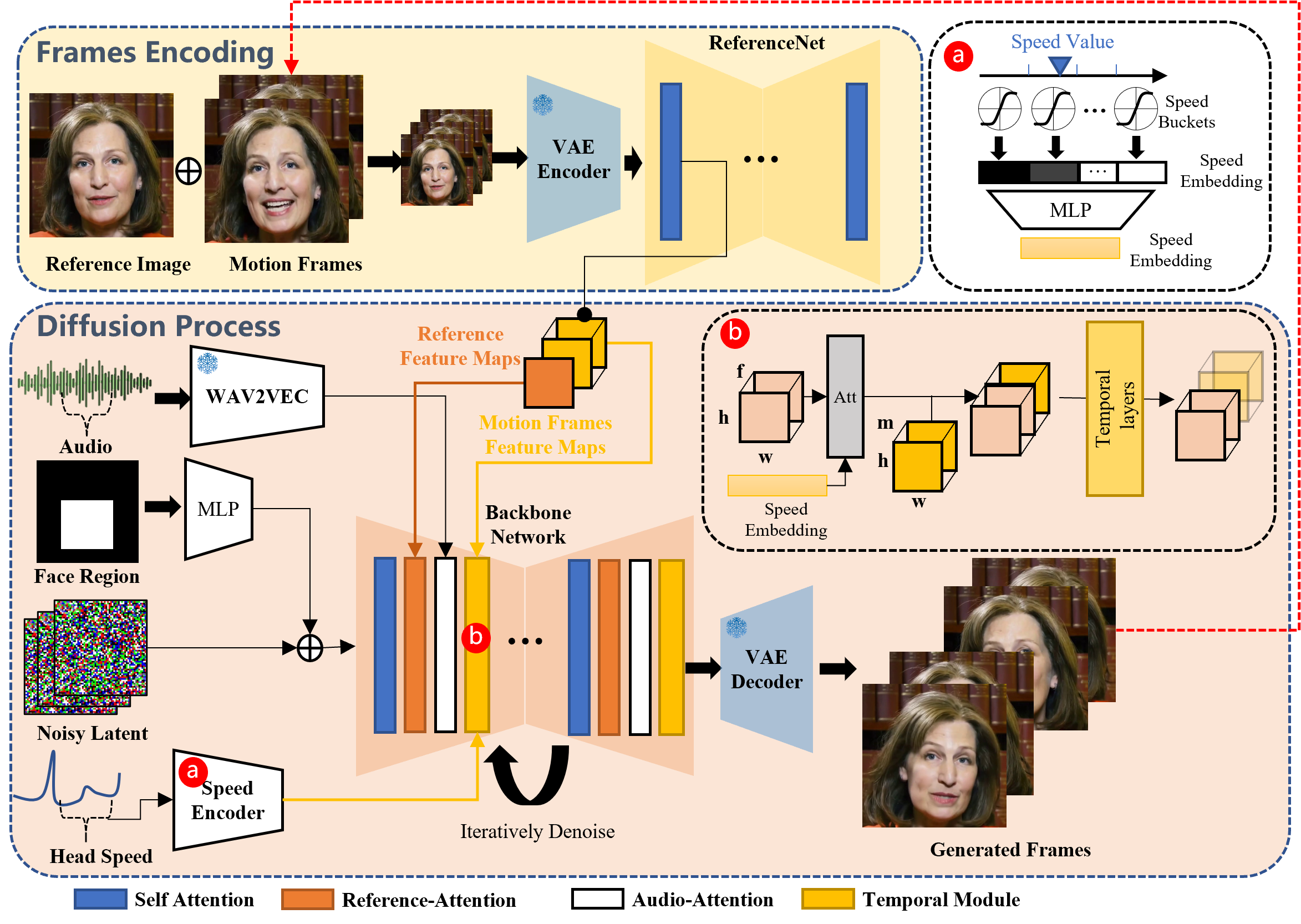

EMO的工作過程: EMO分為兩個主要階段:

- **幀編碼:**利用ReferenceNet分析參考圖像和運動幀,捕捉關鍵特徵。

- **擴散過程:**將預訓練的音頻編碼器與面部區域遮罩和多幀噪聲相結合。辦法解決腦骨網絡,配備了參考注意和音頻注意機制,然後對這些信息進行降噪處理。這些步驟確保了角色的身份完整,同時通過面部表情和頭部運動準確地反映音頻的動態。為確保視頻流暢,時間模塊調整運動速度。

體驗奇蹟:

- **唱歌肖像:**將靜態人物圖像轉換為唱歌化身,有豐富的情感深度和各種頭部姿勢。無論音頻長度如何,我們的技術都能確保視頻中角色身份的一致性。

目的和靈感: 此項目是為學術研究和展示效果而製作的,這是阿里巴巴集團在推動人工智能和機器學習領域突破的證明。此框架是基於Nerfies項目所奠定的基礎上建立的,展示了我們對創新的承諾。

以EMO進入動態肖像的世界,以前所未有的方式將您的聲音賦予圖像生命。

Official Website

demonstrates its power